Kognitivní manipulace, dezinformace a AI v roce 2026

Nová hrozba pro lidský úsudek

Kognitivní manipulace, dezinformace a AI v roce 2026

Jak záměrné narušování reality ohrožuje kvalitu rozhodování a proč IAODG odpovídá právě na tuto výzvu

Stanislav Gazdik PhD., MBA · IAODG · Březen 2026

- 1 Krátkodobé globální riziko: dezinformace (WEF Global Risks Report 2026)

- 2+10 Jediné riziko závažné v obou horizontech: 2 roky i 10 let

- 2026 Deepfaky překročily kritický práh dostupnosti: smartphone stačí

Minulý týden jsme analyzovali data z rozhovorů Anthropicu s 81 000 uživateli AI. Ukázala jednu věc: lidé chtějí kvalitní lidský úsudek, ne jeho delegování. Tentokrát přicházíme s druhou stranou téže mince. Světové ekonomické fórum vydalo v březnu 2026 analýzu, která pojmenovává, co tento úsudek aktivně ničí.

WEF Global Risks Report 2026 zařadil dezinformace na první místo krátkodobých globálních rizik, před geoekonomické konflikty i sociální polarizaci. Nejde přitom o riziko, které by oslabovalo samo sebe. Jde o riziko, které zesiluje všechna ostatní.

| Dezinformace jsou jedním z mála rizik, která zůstávají závažná jak ve dvouletém, tak desetiletém horizontu a zdají se být rizikem, které katalyzuje nebo zhoršuje všechna ostatní rizika na seznamu. WEF Global Risks Report 2026 |

Od online problému k systémové krizi

To, co jsme roky považovali za mediální hygienu, se v roce 2026 stalo otázkou bezpečnosti demokracií. WEF analýza jasně pojmenovává mechanismus: nejde jen o to, že lidé věří nepravdivým informacím. Jde o to, že záměrné narušování informačního prostředí oslabuje samotnou schopnost společnosti rozhodovat se kolektivně, tedy verifikovat fakta, deliberovat o nich a volat k odpovědnosti ty, kdo je zkreslují.

Rok 2026 přichází s konkrétními stresovými testy: hustě nabitý volební kalendář na několika kontinentech, přetrvávající ekonomická nejistota a stále sofistikovanější narativy zprostředkované umělou inteligencí. Podmínky pro manipulaci nikdy nebyly příznivější.

Emocionální zbraňování informací

Nejdůležitější posun, který WEF analýza popisuje, není technologický. Je kognitivní. Oportunistické subjekty, ať již státní nebo soukromé, již nepracují s falešnými fakty jako primárním nástrojem. Pracují s emocemi jako vstupní branou.

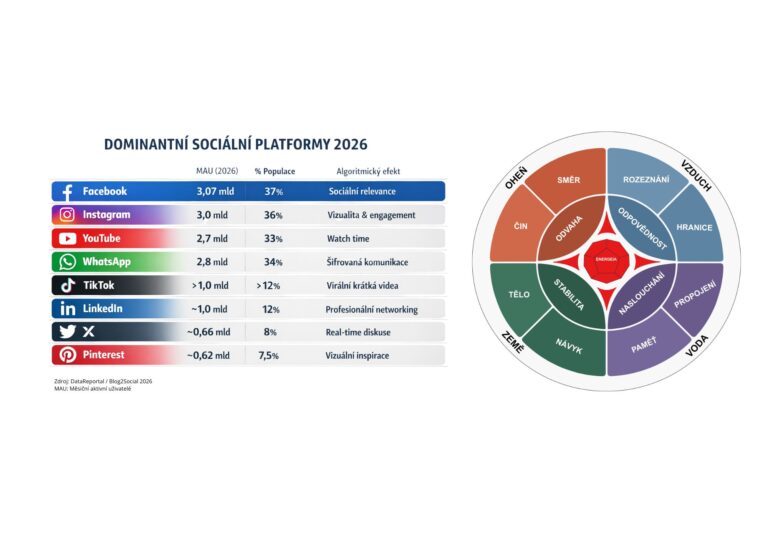

Mikrocílení (micro-targeting) s využitím veřejně dostupných online dat umožňuje identifikovat osobnostní typy a emocionální zranitelnosti cílových skupin. Jde o techniku, při níž algoritmy analyzují chování uživatelů na sociálních sítích a na základě lajků, sdílení a časování aktivit sestavují psychologický profil jedince. Na základě tohoto profilu jsou pak zprávy voleny nikoli pro svou pravdivost, ale pro svou rezonanci, tedy pro schopnost vyvolat hněv, strach nebo potvrzení předchozích přesvědčení. Algoritmy sociálních sítí tento mechanismus zesilují, protože odměňují angažovanost: rozhořčený obsah se sdílí rychleji než stačí jakékoli ověření faktů.

Výsledek je jednoznačný: dezinformace nejsou špatnou žurnalistikou. Jsou záměrně navrženou injekcí do kognitivního systému, mířenou přesně tam, kde je úsudek nejzranitelnější.

Deepfaky jako nová normalita

V roce 2026 deepfaky překročily kritický práh. Deepfake je audiovizuální obsah generovaný umělou inteligencí, který věrohodně zobrazuje reálné osoby při jednáních nebo výrocích, ke kterým nikdy nedošlo. Dřívější charakteristické artefakty, jako jsou nesprávné pohyby rtů nebo nepřirozené mrkání, byly z velké části odstraněny. Tato technologie je dnes dostupná komukoli se smartphonem, nikoli již pouze specializovaným státním aktérům.

Irské prezidentské volby 2025 přinesly konkrétní demonstraci dopadu: falešné video zobrazovalo pozdějšího vítěze, jak stahuje svou kandidaturu, doplněné o záběry národních televizí, které tuto zprávu údajně potvrzovaly. Zveřejněno bylo jen dny před volbami. Nizozemsko zaznamenalo přibližně 400 AI-generovaných snímků použitých k útokům na politické protivníky v průběhu volebního cyklu.

WEF upozorňuje na vedlejší efekt, který je možná závažnější než samotné deepfaky: samotná jejich existence způsobuje, že pochybujeme o všem, co čteme a vidíme, včetně pravdivých informací. Epistemická eroze se šíří dál než jakékoli konkrétní falzum.

| Pouhé vědomí, že deepfaky existují, nás může přimět pochybovat o věcech, které jsou skutečné. WEF, Cognitive manipulation and AI will shape disinformation in 2026, březen 2026 |

Co WEF říká ve světle IAODG metodiky

Analýza WEF a data Anthropicu z minulého týdne sdílejí jeden závěr: oba prameny identifikují krizi lidského úsudku jako centrální téma roku 2026. Liší se perspektivou. Anthropic popisuje, co lidé od AI potřebují zevnitř. WEF popisuje, co je ohrožuje zvenčí. IAODG metodika pracuje s oběma rovinami současně.

Konkrétní průniky jsou následující:

- Emocionální zbraňování informací cílí přesně na kognitivní zkratky, které IAODG systémové pravidlo zakazuje. Pravidlo jednoduše říká: žádný agent nepřijme rozhodnutí za člověka, zejména ne pod emočním tlakem nebo při nedostatku kontextu. Agent slouží jako strukturovaná podpora, nikoli jako náhrada úsudku.

- Mikrocílení na zranitelnosti odpovídá tomu, proč Dodekaedr v IAODG metodice pracuje s orientací, ne s automatizovanou odpovědí. Systém musí nejprve pojmenovat kontext a potenciální zdroje manipulace, aby mohl podpořit kvalitní rozhodnutí.

- Tři pilíře odolnosti podle WEF, tedy verifikace, deliberace a odpovědnost, přímo korespondují s epistemologií pěti hlasů IAODG: bez verifikace není možná deliberace, bez deliberace není odpovědný čin.

- Princip zpomalení při vysokém riziku říká, že při vysokém informačním tlaku, například v době voleb, krize nebo konfliktu, má systém zpomalit a vrátit rozhodnutí člověku. Jde o přesně tu situaci, kdy je tlak na rychlost největší a kdy je zároveň největší riziko chybného rozhodnutí.

- Evropský zákon o umělé inteligenci (EU AI Act) přijatý v roce 2024 vstupuje v roce 2026 do nové fáze vymahatelnosti. Jeho součástí jsou pravidla o povinném označování AI-generovaného obsahu, včetně deepfaků a syntetických interakcí. Porušení těchto pravidel může být pokutováno částkou až do výše šesti procent ročního globálního obratu společnosti. Tento regulační rámec IAODG přijímá jako nutný, avšak nedostatečný: regulace ošetřuje distribuci obsahu, nikoli kvalitu úsudku jeho příjemce.

Odolnost jako trénink, ne jako štít

WEF nabízí tři cesty k odolnosti: technologické nástroje detekce deepfaků, regulaci prostřednictvím EU AI Act a vzdělávání. Finský model, v němž děti ve škole učí rozpoznávat manipulaci, je citován jako příklad, který prokazatelně funguje. Stejně tak koncept narativní inokulace, tedy příprava publika na manipulaci dříve, než k ní dojde.

IAODG k těmto cestám přidává čtvrtou: systematický trénink kvality rozhodovacích procesů u lidí, kteří rozhodnutí přijímají. Technologie a regulace ošetřují prostředí. Vzdělávání buduje povědomí. Odolnost vůči kognitivní manipulaci, tedy schopnost zachovat úsudek pod emočním tlakem, v prostředí falešné autority a záměrné nejistoty, však vyžaduje praxi. Opakovanou, strukturovanou a reflektovanou.

To není abstraktní filozofický postoj. Je to operační požadavek. Lídři, manažeři a instituce, které budou v roce 2026 rozhodovat v podmínkách, které WEF popisuje, potřebují více než mediální gramotnost. Potřebují trénované kognitivní struktury, které obstojí i tehdy, když jsou pod tlakem.

Závěr: Úsudek jako strategická odolnost

Data WEF z března 2026 a data Anthropicu z téhož měsíce ukazují k témuž bodu: schopnost rozhodovat se na základě reality, nikoli na základě emočně nabitých narativů, deepfaků nebo záměrně konstruované nejistoty, je v roce 2026 strategická kompetence.

Nejde jen o to, jak rozeznat deepfake od originálu. Jde o to, jak zachovat schopnost verifikovat, deliberovat a volat k odpovědnosti v prostředí, které je systémově navrženo tak, aby tyto schopnosti oslabovalo.

IAODG na tuto výzvu odpovídá jinak než technologie a jinak než regulace. Odpovídá tréninkem toho, co nelze automatizovat: lidského úsudku v podmínkách tlaku.

Face reality. Think clearly. Act responsibly.

Zdroje:

- Singh, S. a Jagolinzer, A. (2026). Cognitive manipulation and AI will shape disinformation in 2026. World Economic Forum. Dostupné na: weforum.org/stories/2026/03/how-cognitive-manipulation-and-ai-will-shape-disinformation-in-2026

- WEF Global Risks Report 2026. World Economic Forum, leden 2026.

- Huang, S. et al. (2026). What 81,000 People Want from AI. Anthropic. Dostupné na: anthropic.com/features/81k-interviews

Autor: Stanislav Gazdik PhD., MBA · IAODG · iaodg.cz